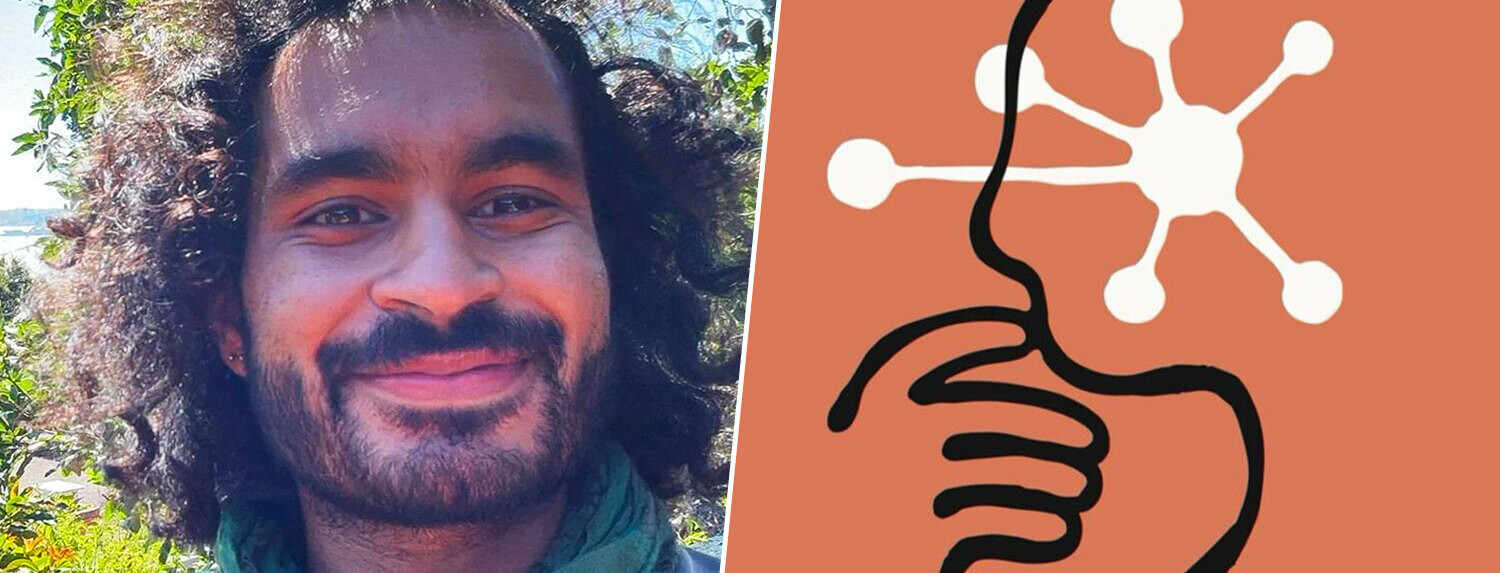

AnthropicのAI安全責任者、Mrinank Sharma氏が辞任 詩作りに専念へ

AnthropicのAI安全責任者、Mrinank Sharma氏が辞任を発表した。彼はXで公開した手紙で、AI開発の危機を警告し、詩作りに人生を捧げると述べた。この動きはAI業界の倫理的ジレンマを象徴する。[約40語]

Anthropicで何をしていたのか?

Sharma氏はAnthropicのSafeguards Research Teamを率いていた。Safeguards Research TeamはAIシステムのリスクを研究するチームだ。

彼の仕事はAI支援バイオテロへの防御開発を含んだ。また、AIモデルのユーザーへのおべっか(sicofancia)を研究した。

さらに、AIが人間の知覚や文化行動に与える影響を調査した。

辞任手紙の内容は?

Sharma氏はXで手紙を公開した。手紙は急速に拡散された。

“世界は危険にさらされている。AIや生物兵器だけでなく、相互接続された一連の危機が今進行中だ”。

彼は人類が倫理的ジレンマに直面していると警告した。AI開発者の叡智が世界影響力に追いつかないと、結果を招くと述べた。

AI開発者の倫理的ジレンマとは?

Sharma氏は「価値観が行動を導くのは難しい」と書いた。重要なことを後回しにする圧力に常に直面した。

- Anthropic社員の懸念:最新AIモデルの進化が速すぎる。

- The Telegraphの報道:「毎日仕事に来て、自分の仕事を失う感覚だ」。

これらの社員はAI技術が自らの仕事を変える開発に携わる。数年以内に数百万人の仕事が変わる可能性がある。

進化の速さは脅威か機会か?

手紙はAIが人類を破壊する武器のように見える。しかし、AnthropicはOpenAIやMicrosoft、xAIより進んでいる証拠だ。

他の企業の開発者は同様の衝撃を感じていないようだ。彼らのモデルはまだその進化段階にないのかもしれない。

詩作りに転向の理由は?

Sharma氏は詩作りを「勇敢な言説の実践」と呼んだ。AI業界のペースと焦点への不満の表れと解釈されている。

他の辞任者との違いは?

最近、Anthropicの重要人物が辞任した。Harsh Mehta氏とBehnam Neyshabur氏だ。

| 人物 | 辞任後 |

|---|---|

| Sharma氏 | 詩作りに専念 |

| Mehta氏・Neyshabur氏 | 新AIプロジェクト開始 |

彼らは倫理より新AI事業を選んだ。Sharma氏の選択は独自だ。

FAQ: AI安全と将来

- AIの最大リスクは? 生物兵器支援やユーザー影響、文化変容。

- Anthropicの強みは? 安全研究チームによる先進性。

- 辞任の波は続くか? 倫理的圧力が原因の可能性。